Come gli LLM stanno complicando il content marketing e la SEO

L’IA non “pensa” come un essere umano; piuttosto, si limita a simulare il comportamento intelligente elaborando dati in modo complesso e coerente.

Quindi, tranquilli: l’umanità non rischia l’estinzione, e dal futuro non arriverà nessuno per uccidere la madre di colui che guiderà la rivoluzione contro Gemini o ChatGPT.

Intelligenza artificiale, modelli LLM, content marketing e SEO

L’intelligenza artificiale e i modelli LLM (Large Language Model) hanno ufficialmente fatto il loro ingresso trionfale nel mondo del content marketing e della SEO, stravolgendo tutto quello che pensavamo di sapere. Flussi di lavoro? Addio alla vecchia routine. Strategie? Meglio riscriverle da capo. Insomma, il potenziale è enorme, cresce a ritmo sostenuto, ed è impossibile ignorarlo.

Ma, ovviamente, non tutto è oro quello che luccica. Questa adozione così rapida ci ha regalato anche qualche piccolo “effetto collaterale”. Originalità e qualità dei contenuti? Un concetto un po’ relativo, ora. Gli output dell’IA, se lasciati a briglia sciolta e senza un’adeguata verifica, rischiano di trasformare la tua brillante strategia SEO in un disastro totale, con più danni che benefici. Perché sì, generare contenuti veloci e abbondanti è fantastico, finché non realizzi che stanno minando la tua reputazione.

In questo articolo – preparati a prenderti appunti – ti svelerò un metodo olistico (suona bene, no?) per integrare gli LLM nel tuo workflow SEO senza far crollare tutto. Ti spiegherò anche come spremere tutto il potenziale dell’IA generativa senza mandare in frantumi il tuo piano. Spoiler: la parola magica è convalida.

Gli LLM sono fantastici… ma non sono maghi

Prima di farti venire l’idea che gli LLM siano dei supereroi pronti a salvarti in ogni situazione, fermiamoci un attimo. Certo, sono strumenti potentissimi, ma – e qui arriva il colpo di scena – non sono adatti a tutto. Capire i loro limiti è cruciale per evitare figuracce epiche e per usarli in modo (più o meno) responsabile.

Ma cos’è un LLM?

Un LLM, o Large Language Model, è un supermodello di intelligenza artificiale che, con fare sapiente, elabora, comprende e genera linguaggio naturale con un livello di accuratezza che farebbe impallidire persino l’insegnante di grammatica più severo.

Questi modelli si basano su reti neurali gigantesche (più grandi, più cool) addestrate su miliardi di parole prese da fonti che vanno dai libri agli articoli fino ai più improbabili angoli di Internet. In pratica, gli LLM sono stati messi davanti a un buffet infinito di dati testuali e hanno imparato tutto quello che c’era da sapere su strutture linguistiche, significati delle parole e contesti.

Per darti un’idea delle loro capacità, un LLM può contenere miliardi (sì, miliardi!) di parametri, che sono le variabili che definiscono come il modello prende decisioni. Tradotto: è come avere un’enciclopedia con un algoritmo geniale che sa cosa dirti, quando dirtelo e, soprattutto, come dirtelo in modo convincente. Risultato? Possono scrivere articoli, tradurre contenuti, rispondere a domande e persino produrre codice. Insomma, multitasking all’ennesima potenza.

E se ti stai chiedendo quali sono gli LLM più famosi, eccoti servito: la serie GPT (Generative Pre-trained Transformer) di OpenAI è la rockstar del momento. Versioni come GPT-3 e GPT-4 stanno già rivoluzionando il modo in cui affrontiamo le attività linguistiche. Altri modelli di rilievo includono BERT di Google (perfetto per capire meglio il contesto) e T5, sempre di Google, che trasforma qualsiasi attività in un simpatico problema di testo da testo.

Dove troviamo gli LLM?

Gli LLM sono ovunque, e no, non è un’esagerazione. Ecco alcuni ambiti in cui stanno già facendo il loro show:

- Chatbot e assistenti virtuali: Sono il motore dietro ogni assistente personale che ti risponde in modo sorprendentemente umano.

- Generazione di contenuti: Articoli, email, post sui social… non sei tu a scriverli, è l’IA.

- Supporto tecnico: Quando un bot ti spiega perché la tua stampante non funziona, puoi ringraziare un LLM.

- Ricerca e analisi: Non c’è bisogno di setacciare montagne di dati: ci pensa l’IA.

Sì, ma gli LLM sono davvero così rivoluzionari?

Assolutamente sì. I grandi modelli linguistici rappresentano un balzo in avanti incredibile nel mondo dell’intelligenza artificiale. La loro capacità di parlare (o scrivere) in modo così naturale e sofisticato li rende strumenti imprescindibili per moltissimi settori, dalla comunicazione alla ricerca scientifica. Certo, sono pieni di difetti, limitazioni e a volte un pizzico di arroganza computazionale, ma diciamolo: chi non lo è?

Come funziona ChatGPT

Hai mai pensato a come ChatGPT riesca a sfornare risposte così brillanti (quasi sempre) alle tue domande? Beh, non è magia. È un processo un po’ meno glamour di quanto potresti immaginare, ma comunque interessante. E, indovina un po’? Ha più somiglianze con i vecchi motori di ricerca di quanto vorrebbero farti credere. Ecco come funziona:

1. Raccolta dei dati: “Ti rispondo con quello che so”

Il primo passo è, ovviamente, la raccolta delle informazioni. ChatGPT, come un motore di ricerca della vecchia scuola, si nutre di montagne di dati raccolti da fonti diverse: pagine web, libri, articoli e chissà cos’altro. Ma, attenzione: se non ha mai “visitato” una determinata pagina o non ha avuto accesso a una specifica fonte, semplicemente non conosce la risposta. Non c’è trucco, non c’è inganno.

Ed ecco il punto dolente: mentre i motori di ricerca tradizionali (ciao Google!) hanno avuto decenni per rastrellare ogni angolo di Internet, ChatGPT è come uno studente che ha appena iniziato a studiare per gli esami finali. Tradotto: ci sono ancora un sacco di cose che gli sfuggono.

Certo, ChatGPT ha un asso nella manica che i motori di ricerca non hanno: i dati delle chat. Ogni volta che interagisci con lui, i tuoi input (le domande che fai e le conversazioni che avvii) potrebbero essere raccolti per migliorare i modelli futuri. Quindi, sì, in teoria stai “insegnando” al modello mentre lo usi. E no, non è sempre una buona notizia: inserire informazioni private potrebbe non essere l’idea più brillante del mondo. Se ci tieni alla tua privacy, ti consiglio di dare un’occhiata alle impostazioni o di utilizzare le API, che di solito non vengono utilizzate per addestrare i modelli.

2. Salvataggio delle informazioni: “Indicizzare è il nuovo ricordare”

Il secondo passaggio è un po’ come l’indicizzazione nei motori di ricerca. Sai, quel processo grazie al quale Google sa sempre cosa dirti quando cerchi qualcosa (tranne quando cerchi il nome di un film che hai visto dieci anni fa e ti ricordi solo una scena imbarazzante).

Nei primi giorni dei motori di ricerca, gli indici non venivano aggiornati continuamente. Pubblicavi qualcosa online, e potevano passare mesi prima che fosse indicizzato. Poi, per fortuna, le cose si sono velocizzate.

ChatGPT, invece, è ancora un po’ nella “fase iniziale”. Le informazioni che conosce non vengono aggiornate in tempo reale. Ogni tanto, le aziende annunciano che i dati del modello sono stati aggiornati fino a una certa data (tipo “i dati sono aggiornati fino ad aprile 2023”), e basta. Perché? Perché aggiornare un modello del genere è come provare a rifare un puzzle di 10 miliardi di pezzi: richiede tempo, soldi e tanta pazienza.

3. Generazione della risposta: “Ecco quello che ho, spero ti basti”

Ed eccoci al gran finale: il momento in cui ChatGPT ti dà la risposta alla tua domanda. Il problema? La qualità della risposta dipende interamente dai dati raccolti e indicizzati. Se il modello non ha mai visto le informazioni che stai cercando, o se i dati che ha sono obsoleti, la risposta potrebbe essere… diciamo “creativa”.

Hai mai chiesto qualcosa a ChatGPT e ottenuto una risposta che sembrava un po’ fuori tema? Ora sai perché. Non è che non voglia aiutarti, è solo che, in certi casi, non ha proprio idea di cosa stai parlando.

In sintesi, ChatGPT è un genio con qualche lacuna nella memoria e un metodo di lavoro che, nonostante tutta la sua innovazione, sembra un po’ un mix tra vecchi motori di ricerca e un collaboratore un po’ distratto. Funziona, certo, ma solo finché gli dai i giusti input e lo mantieni aggiornato.

Allora, ti sei mai chiesto come ChatGPT riesca a rispondere alle tue domande con quella sicurezza quasi fastidiosa? La verità è che non è che sappia tutto. No, il trucco sta nel fatto che tu gli dai una marea di informazioni, lo riempi di contesto, e lui ti risponde come se fosse un genio. In pratica, gli fai fare il compito con un bigliettino sotto il banco.

Magari hai persino chiesto a Bing di andare a spulciare qualcosa per te. Eh già, benvenuti nella nuova era della dinamica uomo-macchina: tu fai metà del lavoro, l’IA si prende i complimenti. Questi grandi modelli linguistici hanno una particolarità interessante: possiamo compensare le loro evidenti lacune nella “memoria a lungo termine” caricandoli di roba nella “memoria a breve termine”. In parole povere, gli butti dentro un sacco di testo, e loro lo elaborano lì, sul momento, come studenti che ripassano all’ultimo minuto prima di un esame.

Ma sai qual è la cosa davvero divertente?

Anche se tu non stai facendo niente di tutto questo manualmente, è comunque quello che succede in background. Ecco come funziona davvero:

ChatGPT, con tutto il suo fare da assistente brillante, non ha alcuna memoria di quello che ti ha detto la volta precedente. Niente. Nada. Tabula rasa. Ogni volta che scrivi qualcosa, dietro le quinte c’è uno script che copia tutta la conversazione fino a quel momento e aggiunge il tuo nuovo messaggio, presentandolo al modello come una sorta di compito di scrittura creativa.

In pratica, è come dire al modello:

“Ecco una conversazione tra una persona e un’IA. Ecco cosa è stato detto finora. Ecco una domanda alla fine. Ora, che cosa diresti dopo?”

Ed è così che ChatGPT tira fuori la sua magia. Ma no, non ha un diario segreto in cui annota tutto ciò che hai detto. Ogni volta è come se ricominciassimo da capo.

Perché dovresti saperlo?

Beh, perché tutta questa faccenda del “non ho memoria” cambia il modo in cui dobbiamo interagire con questi strumenti. Praticamente, ogni volta che vuoi ottenere qualcosa di sensato, devi scaricare tutto il contesto nella loro memoria a breve termine. Certo, è fantastico quando funziona, ma ha i suoi limiti.

Per esempio, hai presente quando una conversazione diventa troppo lunga e ChatGPT inizia a dimenticare i pezzi iniziali? Ecco, è perché la sua “memoria a breve termine” ha una capacità limitata, un po’ come quando cerchi di ricordarti tutto ciò che devi comprare al supermercato e lasci le chiavi in macchina.

La prossima volta che parli con ChatGPT…

Ricorda: non sta davvero pensando. Non ha memoria. Non sa cosa ti ha detto prima. Sta solo elaborando quello che gli hai dato in quel momento, come un bravo studente che cerca di fare bella figura durante un’interrogazione orale. Quindi, se vuoi che funzioni bene, preparati a essere chiaro, conciso e, soprattutto, a dare tutto il contesto possibile. Perché se ti aspetti che ricordi qualcosa da solo… buona fortuna!

Finestre di contesto

In passato, il problema principale era quanto contesto si riusciva a inserire in una conversazione. Le finestre di contesto erano ridotte, e incollare grandi quantità di informazioni era semplicemente fuori discussione.

Oggi, invece, la situazione è cambiata. Con modelli come OpenAI GPT-4.5, puoi incollare circa 300 pagine di testo, mentre Anthropic, un concorrente importante, arriva a circa 500 pagine. Insomma, ora puoi riversare una quantità impressionante di informazioni in un prompt.

Il risultato? Il limite non è più la quantità di testo che puoi incollare, ma il tuo livello di pazienza nel farlo.

Problemi che ChatGPT deve superare

Le aziende e gli sviluppatori di modelli linguistici si trovano ancora ad affrontare sfide significative, nonostante i progressi nella capacità di gestire grandi quantità di contesto.

Limiti di conoscenza e contesto breve

Anche se strumenti come GPT-4.5 o Anthropic possono gestire centinaia di pagine di testo, 500 pagine non sono l’intera Internet. Le lacune di conoscenza non possono essere colmate semplicemente incollando enormi quantità di dati nella finestra di contesto. E qui arriva il secondo problema: il sovraccarico di contesto.

Liu et al. e altri ricercatori hanno scoperto che, quando troppe informazioni vengono inserite nei prompt, e quelle chiave sono sepolte in mezzo al testo, l’accuratezza nell’estrazione delle informazioni diminuisce drasticamente. È un po’ come cercare un ago in un pagliaio. Più roba c’è, più difficile diventa per il modello individuare ciò che conta davvero.

Soluzioni pratiche: non è solo questione di pagare per un modello più costoso

Paradossalmente, si ottengono risultati migliori prendendo le informazioni chiave e mettendole all’inizio del prompt, piuttosto che spendendo per un modello più potente. Questo approccio strategico ottimizza l’attenzione del modello e riduce il rischio che informazioni rilevanti vengano ignorate.

Come possiamo lavorare meglio con i modelli

Ecco alcune strategie per affrontare questi problemi:

- Usare nuove chat: Quando si passa da un argomento all’altro, avviare una nuova chat è un modo semplice per evitare confusione e migliorare l’attenzione del modello.

- Creare prompt ben strutturati: Meglio concentrarsi su istruzioni concise e rilevanti, evitando di inserire informazioni superflue che rischiano di nascondere ciò che conta.

- Filtrare il contenuto: Prima di incollare grandi blocchi di testo, rimuovere ciò che non è strettamente pertinente. Questo aiuta il modello a focalizzarsi sulle parti essenziali.

Generazione Aumentata di Recupero (RAG)

Un approccio interessante per affrontare queste sfide è la Generazione Aumentata di Recupero (RAG). Qui, invece di affidarsi esclusivamente al contesto fornito nel prompt, il modello interagisce con un sistema esterno di recupero delle informazioni. In pratica, il modello accede a database o altre fonti per recuperare solo le informazioni pertinenti, integrandole dinamicamente nel processo di generazione.

RAG non solo migliora la qualità delle risposte, ma riduce anche il carico cognitivo del modello, consentendogli di lavorare in modo più mirato e preciso.

RAG: La soluzione tecnologica che potrebbe cambiare il gioco

C’è un’altra soluzione ai problemi dei modelli linguistici, ed è un po’ più tecnologica, un po’ più “aziendale”. Ma è anche qualcosa che, come industria in crescita, dovremmo tenere d’occhio. Si chiama RAG, ovvero retrieval augmented generation.

Come funziona? Beh, invece di inviare la tua domanda direttamente a ChatGPT senza nessun altro supporto, RAG utilizza un database separato per gestire le informazioni importanti che vuoi integrare. Ad esempio, potrebbe trattarsi di tutta la documentazione interna della tua azienda che, giustamente, non vuoi mettere in pasto a Internet. Oppure, semplicemente, di un mucchio di dati che sai essere rilevanti ma che non puoi fisicamente incollare nel prompt.

Ed è qui che entrano in gioco i database vettoriali, strumenti progettati per lavorare in armonia con i grandi modelli linguistici. In pratica, questi database estraggono automaticamente i documenti più pertinenti da inserire nel prompt, senza che tu debba scervellarti a cercarli e incollarli manualmente. Il risultato? Un processo più snello, un contesto più completo e una maggiore privacy. RAG è, in sostanza, il segretario organizzato che tutti vorremmo.

RAG e il futuro della facilità d’uso

Questo approccio automatizza molti dei passaggi che oggi facciamo manualmente, risolvendo anche alcuni dei problemi principali legati alle lacune di conoscenza dei modelli. Ma cosa significa per noi?

Per ora, non ci pesa troppo fare un po’ di copia e incolla. Questi strumenti sono ancora così nuovi che ci adattiamo facilmente. Tuttavia, arriveremo al punto in cui inizieremo a confrontarli in base a quanto non ci fanno lavorare. Devo davvero ricordare a ChatGPT cosa gli ho detto la scorsa settimana? Se sì, forse passerò a uno strumento che non ha bisogno di così tante spiegazioni.

La memoria a tre livelli: il futuro dei modelli linguistici

RAG potrebbe essere la chiave per superare questi limiti, portando i modelli linguistici verso un sistema di memoria a tre livelli:

- Memoria a lungo termine: il modello stesso, con tutte le informazioni pre-addestrate.

- Memoria a breve termine: ciò che inserisci nel contesto della chat in tempo reale.

- Memoria a medio termine: informazioni rilevanti che il modello può recuperare automaticamente da un database separato, senza doverle incorporare direttamente nel suo addestramento.

Con questo approccio, non solo si colmano le lacune di conoscenza, ma si rendono questi strumenti più facili e intuitivi da usare. E, alla fine, questo potrebbe fare davvero la differenza per chi li usa quotidianamente.

RAG e l’ottimizzazione per i modelli linguistici: non è così diverso dalla SEO

Se decidi di provare RAG da solo – e hai competenze di programmazione, un po’ di tempo libero e la voglia di smanettare – scoprirai che molte delle conclusioni a cui arriverai ti sembreranno stranamente familiari. Prendi ad esempio HTML: è un linguaggio incredibilmente flessibile e, quando una pagina è ben progettata con intestazioni e struttura adeguata, estrarre le informazioni rilevanti diventa un gioco da ragazzi.

Ora, confronta due pagine: una piena di informazioni irrilevanti con un paio di dettagli utili nascosti, e un’altra che è mirata, chiara e pertinente. Quale pensi che un modello o un crawler favorirà? Esatto, la seconda. Le stesse regole che valgono per l’ottimizzazione SEO sono incredibilmente rilevanti quando si parla di RAG. Anche se non usi esattamente la RAG, ricordati che i modelli linguistici devono comunque scansionare, analizzare e comprendere le informazioni per darti una risposta.

Quindi, avere contenuti ben strutturati, facili da comprendere e pertinenti è sempre una buona idea. Non solo per i motori di ricerca, ma anche per prepararsi all’interazione con i grandi modelli linguistici del futuro.

Cose da ricordare

- Privacy dei dati: Se stai usando strumenti come ChatGPT, ricorda che i dati non sono sempre privati. Controlla le impostazioni o valuta l’utilizzo delle API per avere maggiore controllo.

- Focalizza il contesto: Quando incolli dati nei tuoi prompt, cerca di filtrare le informazioni irrilevanti per aumentare le probabilità di ottenere una risposta utile.

- Ottimizzazione SEO e modelli linguistici: Se stai lavorando sull’ottimizzazione del tuo sito web, continua a concentrarti su ciò che funziona per i motori di ricerca. È altamente probabile che le stesse strategie saranno fondamentali anche per interagire con i modelli linguistici in futuro.

In sintesi, tutto ciò che stai facendo ora per migliorare la comprensibilità e la struttura del tuo contenuto non sarà solo utile per i motori di ricerca, ma potrebbe diventare cruciale quando i grandi modelli linguistici inizieranno a diventare una parte fondamentale del web.

Scenari in cui NON utilizzare gli LLM

Anche se i modelli linguistici di grandi dimensioni (LLM) sono strumenti straordinariamente versatili, ci sono contesti in cui il loro utilizzo può essere inappropriato o addirittura rischioso. Ecco alcuni esempi pratici:

1. Decisioni sensibili o critiche

Non affidare agli LLM compiti che richiedono un alto grado di precisione o che coinvolgono dati sensibili.

Ad esempio:

- Raccomandazioni legali o mediche: un errore potrebbe avere gravi conseguenze, e l’esperienza umana è indispensabile.

- Diagnosi mediche o interpretazione di leggi: queste attività richiedono competenze altamente specializzate che gli LLM non possono garantire in modo affidabile.

2. Lavoro creativo ad alto rischio

Quando l’originalità è cruciale, come nella creazione di campagne di branding uniche, gli LLM rischiano di produrre contenuti generici o privi di ispirazione.

- Esempio: una campagna pubblicitaria che deve distinguersi potrebbe risultare piatta o prevedibile se affidata completamente a un LLM.

3. Ambienti sensibili ai dati

Condividere informazioni riservate o proprietarie con un LLM comporta seri rischi per la sicurezza.

- Consiglio pratico: Anonimizza sempre i dati e non includere dettagli critici o informazioni personali.

- Evita di utilizzare LLM per elaborare informazioni aziendali riservate o altre informazioni sensibili che potrebbero esporre la tua organizzazione a vulnerabilità.

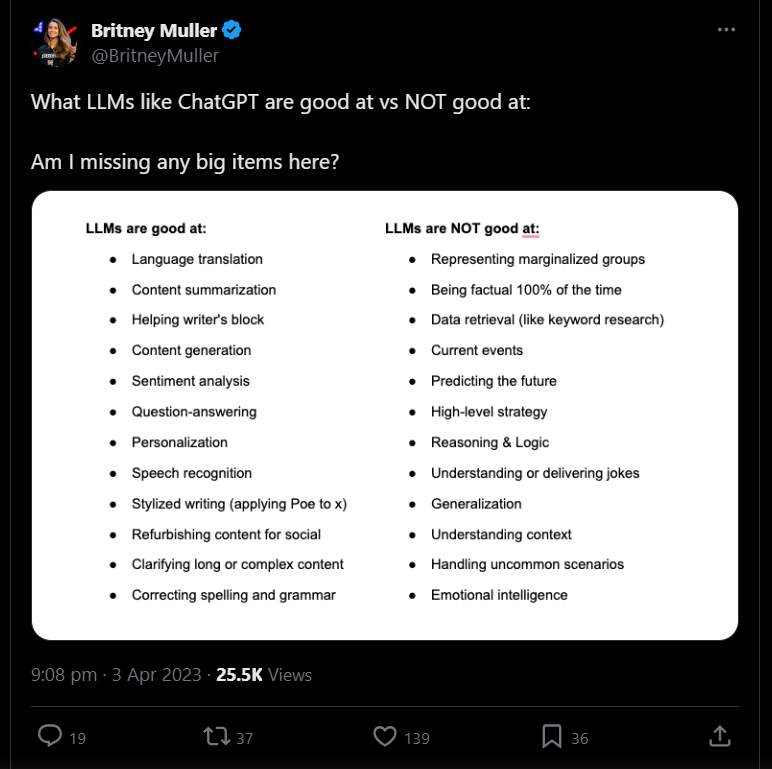

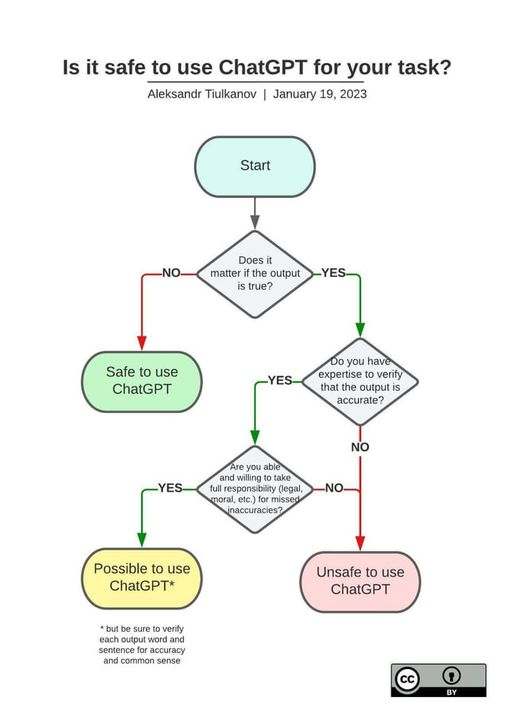

Come evidenziato da Britney Muller, ci sono compiti in cui gli LLM eccellono e altri che richiedono un intervento umano. Il segreto sta nel capire dove il supporto di un LLM può realmente fare la differenza e dove invece è meglio lasciar perdere.

Tre modi per integrare gli LLM nel tuo flusso di lavoro SEO

1. Ottimizzazione dei prompt

La qualità delle risposte di un LLM dipende in gran parte da come formuli le tue domande. Per ottenere risultati chiari, pertinenti e utili, è fondamentale creare richieste precise e ben strutturate.

- Perché è importante? Un prompt ottimizzato riduce il numero di iterazioni necessarie e consente di risparmiare tempo, aumentando l’efficienza complessiva.

- Esempio pratico: Invece di chiedere “Dammi consigli SEO”, prova con “Fornisci una strategia SEO per aumentare il traffico organico su un blog di tecnologia rivolto a un pubblico europeo.”

L’obiettivo è fornire al modello tutto il contesto necessario per ricevere risposte personalizzate e immediatamente attuabili.

Un approccio efficace per ottenere risposte mirate dagli LLM è strutturare i tuoi prompt utilizzando il modello delle 5W e H (What, Where, Who, When, Why, How). Questo metodo assicura che le richieste siano dettagliate e precise, migliorando la qualità delle risposte al primo tentativo.

Ecco come applicarlo:

- What (Cosa): Qual è l’attività? Specifica l’azione principale, ad esempio “genera cinque tag di titolo ottimizzati”.

- Where (Dove): Dove verrà utilizzato? Fornisci il contesto, ad esempio “su una pagina di categoria jeans bianchi”.

- Who (Chi): Chi è il pubblico di riferimento? Identifica l’audience, ad esempio “potenziali acquirenti di jeans”.

- When (Quando): Quando verrà utilizzato? Definisci il momento o la frequenza, ad esempio “su base continuativa”.

- Why (Perché): Perché vuoi utilizzarlo? Spiega lo scopo, ad esempio “coinvolgere il pubblico e migliorare il posizionamento nei motori di ricerca”.

- How (Come): Come dovrebbe essere formattato? Specifica tono, struttura o vincoli, ad esempio “coinvolgente, descrittivo, pertinente, sotto i 50 caratteri, conforme alle best practice SEO”.

Esempio pratico di prompt ottimizzato:

“Genera cinque tag di titolo SEO-friendly per una pagina di categoria jeans bianchi. Il pubblico è costituito da potenziali acquirenti di jeans e il tono dovrebbe essere coinvolgente e descrittivo. Ogni titolo dovrebbe essere inferiore a 50 caratteri, ottimizzato per i risultati di ricerca.”

Con un prompt così dettagliato, l’LLM può fornire risposte più accurate e pertinenti, eliminando la necessità di numerosi tentativi.

2. Creazione di librerie di prompt personalizzate

La creazione di una libreria di prompt personalizzati è un altro modo per integrare gli LLM nel tuo flusso di lavoro SEO in modo efficiente.

- Perché farlo: Una libreria ben organizzata ti permette di risparmiare tempo e garantisce coerenza nelle attività ripetitive.

- Come farlo: Identifica le richieste che utilizzi frequentemente, come la creazione di titoli, descrizioni meta o contenuti per post sui social media, e salva i prompt ottimizzati in un file o un database facilmente accessibile.

Esempio di prompt da libreria:

“Scrivi una meta description accattivante per una pagina di categoria jeans bianchi, ottimizzata per il SEO, con meno di 160 caratteri.”

Con una libreria pronta, ridurrai il tempo speso a formulare richieste e migliorerai l’efficienza complessiva del tuo flusso di lavoro.

Le librerie di prompt ben organizzate sono uno strumento essenziale per ottimizzare il tuo flusso di lavoro SEO. Ecco come crearle e utilizzarle al meglio:

Crea prompt riutilizzabili

- Identifica attività ricorrenti: Ad esempio, generazione di tag di titolo, meta descrizioni o schemi di contenuto.

- Sviluppa prompt efficaci: Utilizza il modello delle 5W e H per creare richieste precise e affidabili.

- Esempio:

“Scrivi una meta descrizione per [pagina/argomento]. Utilizza un tono accattivante, includi la parola chiave [parola chiave] e mantienila sotto i 160 caratteri.”

- Esempio:

Organizza i prompt per un accesso rapido

- Categorizza i prompt: Dividili per tipo di attività (ad esempio, SEO tecnica, creazione di contenuti, analisi della concorrenza).

- Memorizza e recupera facilmente i prompt: Usa strumenti come Google Sheets, Notion o un database dedicato per salvare, taggare e ritrovare rapidamente i tuoi prompt.

Standardizza i flussi di lavoro tra i team

- Condividi la libreria: Assicurati che il tuo team abbia accesso alla libreria per mantenere coerenza nei progetti collaborativi.

- Aggiorna regolarmente: Incoraggia i membri del team a contribuire con nuovi prompt e a migliorare quelli esistenti in base alle necessità.

Una libreria ben organizzata riduce il tempo necessario per avviare le attività e garantisce una maggiore consistenza nei risultati.

Collegare gli strumenti SEO a OpenAI

Gli strumenti SEO stanno integrando sempre più le funzionalità dei modelli linguistici, come ChatGPT, nelle loro piattaforme. Questo consente di generare insight e raccomandazioni direttamente all’interno del tuo flusso di lavoro, eliminando la necessità di passaggi aggiuntivi.

Ecco alcuni esempi di strumenti SEO con integrazione AI e i loro casi d’uso:

1. SEOTesting.com

Funzionalità: Integrazione con ChatGPT per ottimizzazione dei contenuti e reporting.

Caso d’uso:

- Identifica pagine con prestazioni scarse o metadati deboli.

- Migliora i metadati aggiungendo parole chiave mancanti o riformulando tag di titolo in base all’intento della parola chiave.

2. Horseman SEO Crawler

Funzionalità: Combina audit tecnico con raccomandazioni sui contenuti.

Casi d’uso principali:

- Generazione di meta descrizioni: Crea automaticamente descrizioni per pagine prive di metadati, in linea con le parole chiave pertinenti.

- Estrazione delle parole chiave: Analizza il contenuto della pagina per individuare parole chiave mancanti e suggerirne l’integrazione.

- Informazioni tecniche SEO: Fornisce consigli pratici senza codice per risolvere problemi tecnici rilevati durante la scansione.

3. Moz Site Crawl

Funzionalità: Offre un’analisi SEO più ampia, con un focus su reindirizzamenti, errori di scansione e metadati mancanti.

Vantaggi principali:

- Prioritizzazione delle correzioni in base all’impatto SEO.

- Il loro Rogerbot proprietario garantisce audit dettagliati anche per siti web complessi.

Confronto rapido:

- Horseman SEO Crawler: Perfetto per ottimizzazione dei metadati e analisi delle parole chiave.

- Moz Site Crawl: Ideale per un’analisi completa, coprendo una gamma più ampia di problemi tecnici.

Integrando questi strumenti con LLM, puoi semplificare notevolmente il tuo lavoro SEO, ottimizzando tempo e risorse senza sacrificare la qualità.

4. Numerous.ai

Numerous.ai porta l’integrazione di OpenAI direttamente in Google Sheets, consentendo di gestire operazioni su larga scala, come la classificazione delle parole chiave, l’analisi del sentiment e la riscrittura dei contenuti. Questo strumento è particolarmente utile per automatizzare attività ripetitive su grandi set di dati, risparmiando tempo e aumentando l’efficienza.

Casi d’uso principali per Numerous.ai

1. Analisi dell’intento di ricerca

Come funziona: Utilizza Numerous.ai per eseguire analisi in blocco delle parole chiave e identificare rapidamente l’intento di ricerca. Ad esempio, il tool può classificare automaticamente le parole chiave come:

- Transazionale (es. “acquista jeans bianchi online”)

- Informativo (es. “come scegliere i jeans bianchi perfetti”)

- Commerciale (es. “migliori marche di jeans bianchi”)

- Di navigazione (es. “sito ufficiale Levi’s”).

Perché è utile: Analizzare manualmente l’intento di ricerca di migliaia di parole chiave può essere estremamente dispendioso. Con Numerous.ai, puoi processare grandi volumi di dati in pochi minuti.

2. Riscrittura dei contenuti

- Cosa fa: Ti consente di riscrivere intere sezioni di testo direttamente in Google Sheets. Puoi, ad esempio, ottimizzare descrizioni di prodotto o meta descrizioni su larga scala senza dover copiare e incollare i testi su altre piattaforme.

- Esempio pratico: Riscrivere 100 meta descrizioni per un sito di e-commerce in modo che siano uniche, SEO-friendly e coinvolgenti.

3. Analisi del sentiment

- Come funziona: Numerous.ai analizza il sentiment di grandi set di dati, come recensioni di clienti o commenti sui social media, identificando toni positivi, negativi o neutri.

- Applicazione SEO: Può aiutarti a capire come gli utenti percepiscono un marchio o un prodotto, migliorando così il copy delle pagine di destinazione o le strategie di content marketing.

Perché scegliere Numerous.ai?

Numerous.ai è una soluzione ideale per:

- Attività su larga scala: Perfetto per chi gestisce grandi set di dati, come siti e-commerce o analisi SEO approfondite.

- Accessibilità: Integrandosi direttamente con Google Sheets, offre un’interfaccia familiare e intuitiva, eliminando la necessità di utilizzare software separati.

- Efficienza: Automatizza attività che, manualmente, richiederebbero ore o giorni, consentendo di concentrarsi su strategie più importanti.

Per attività su scala più piccola, Numerous.ai in combinazione con Google Sheets rappresenta una soluzione rapida, efficace e altamente accessibile.

Per carichi di lavoro complessi o progetti di livello aziendale, strumenti come la Moz API si rivelano inestimabili. La Moz API non solo semplifica le operazioni di gestione delle parole chiave, ma fornisce anche punteggi di intenti di ricerca aggiornati per parole chiave nel suo database, offrendo una base solida per decisioni strategiche su progetti ad alto rischio.

Casi d’uso principali della Moz API

1. Classificazione delle parole chiave

- Funzionalità: Analizza grandi elenchi di parole chiave e li organizza in categorie principali o argomenti principali.

- Applicazione: Ideale per grandi progetti SEO in cui è necessario suddividere liste di migliaia di parole chiave per creare piani di contenuti o strategie di targeting.

2. Generazione di contenuti in blocco

- Funzionalità: Automatizza la creazione di elementi essenziali per il SEO, come:

- Titoli

- Meta descrizioni

- Tag H1

- FAQ

Applicazione pratica: Genera contenuti ottimizzati per un gruppo di pagine, riducendo il tempo necessario per produrli manualmente e mantenendo la coerenza stilistica.

3. Riscrittura dei modelli di contenuto

- Funzionalità: Riscrivi modelli di contenuti esistenti per adattarli a diverse categorie, posizioni o inserzioni.

- Esempio: Personalizza descrizioni di prodotto per un e-commerce su base regionale o per mercati diversi, garantendo unicità e pertinenza.

Bilanciare l’automazione con l’esperienza umana

Sebbene strumenti avanzati come i modelli linguistici di grandi dimensioni (LLM) semplifichino enormemente i flussi di lavoro e accelerino la generazione di contenuti, non bisogna mai sottovalutare l’importanza della supervisione umana.

Gli LLM sono eccellenti nel fornire insight e nel creare bozze, ma affidarsi esclusivamente a loro può portare a errori o a risultati che non rispettano appieno le linee guida del marchio. L’equilibrio ideale:

- Automazione per attività ripetitive e analisi di grandi set di dati.

- Supervisione umana per garantire accuratezza, creatività ed etica.

In definitiva, integrare strumenti come l’LLM nei flussi di lavoro SEO consente di scalare le operazioni, mantenendo alta la qualità e l’efficacia dei risultati.

Se ti ritrovi con i guru del marketing che ti promettono soluzioni facili, allora comprenderai il fascino degli strumenti di intelligenza artificiale generativa come ChatGPT.

Per chi lavora nel marketing, sia lato cliente che lato agenzia, l’idea di evitare il tormento della pagina bianca e arrivare direttamente alla soddisfazione di un articolo pubblicato è difficile da ignorare. È come un fast food: ti promette soddisfazione senza il minimo sforzo.

Personalmente, ho messo piede nel mondo dell’IA generativa a novembre 2022. All’inizio ero affascinato dalla rapidità con cui ChatGPT poteva produrre paragrafi apparentemente ben scritti. Mi sembrava di aver trovato lo strumento che mi avrebbe trasformato in una macchina da scrivere (e non nel senso vintage). Ma più mi addentravo nel testare diversi modelli linguistici e strumenti di IA generativa, più mi rendevo conto dei rischi. Specialmente perché, lavorando con clienti, ho la responsabilità di fornire consigli ben documentati, coerenti e credibili.

Ecco perché questo articolo è un tentativo di fornire linee guida per chi, giustamente, è scettico nei confronti della rivoluzione dell’IA.

Alcune regole base che dovremmo tutti seguire

Proteggi sempre le informazioni riservate

Mai, e ripeto mai, inserire dati aziendali riservati o sensibili in un modello di IA. Questo include informazioni aziendali proprietarie, proprietà intellettuale non pubblica, dataset privati, strategie di business, report interni, dati sui clienti o qualsiasi altro materiale confidenziale.

Diverse aziende, tra cui Amazon, hanno già limitato l’uso di strumenti come ChatGPT o GitHub Co-Pilot proprio per timore che informazioni riservate possano essere immagazzinate e successivamente utilizzate come dati di addestramento, creando il rischio di potenziali fughe di dati.

Personalmente, faccio sempre un passo ulteriore: sostituisco nomi o dettagli specifici con pseudonimi. Se hai bisogno di fornire dati reali per dare contesto, assicurati di anonimizzare tutte le informazioni personali (PII) o sensibili, usando sostituti inventati o generici.

Il consenso è fondamentale

Se vuoi utilizzare dati di un cliente, assicurati di avere i permessi necessari. Condividere dati con un modello di IA può essere considerato a tutti gli effetti una forma di condivisione di informazioni e potrebbe violare accordi di riservatezza o normative sulla protezione dei dati. Quindi, procedi con cautela e non dare per scontato che tu abbia l’autorizzazione a condividere tali dati. Se hai dubbi, consulta un legale.

Molti clienti e aziende sono ormai consapevoli che strumenti di IA generativa vengono utilizzati come parte del lavoro. Essere trasparenti su come utilizzi questi strumenti e su come affronti il tema del consenso e della condivisione dei dati può aiutarti a dimostrare che comprendi i rischi e che hai adottato misure per mitigarli.

Controlla rigorosamente gli output

Esamina sempre con attenzione i contenuti generati per assicurarti che non includano accidentalmente dati sensibili. Gli strumenti di IA possono inferire informazioni basandosi sui dati forniti e, in alcuni casi, generare contenuti sensibili o che sembrano provenire da fonti terze.

Inoltre, rivedi gli output per verificare che non contengano riferimenti non intenzionali a informazioni proprietarie o sensibili relative al cliente o all’azienda.

Evita le violazioni della proprietà intellettuale

Se utilizzi strumenti come Midjourney per creare immagini o ChatGPT per scrivere testi, evita di usare prompt come “nello stile di X”. Questo potrebbe portare a violazioni delle leggi sul copyright, ed è francamente una scorciatoia estremamente pigra, anche quando fai riferimento ad artisti storici il cui lavoro non è più protetto da copyright.

Un esempio recente riguarda le polemiche sollevate da artisti contro l’imitazione del loro stile da parte dell’IA. Tuttavia, puoi tranquillamente utilizzare le indicazioni sul tono di voce del cliente per guidare la generazione di testi.

Oltre a evitare di replicare lo stile di autori o artisti specifici, rispetta sempre i diritti di proprietà intellettuale. Questo include testi, immagini, design o qualsiasi altro contenuto che potrebbe essere soggetto a copyright.

Non fidarti ciecamente degli output

Will Moy, CEO di Full Fact, ha recentemente spiegato al comitato britannico su disinformazione e fiducia che “la capacità di inondare il dibattito pubblico con testi, immagini, video e dataset apparentemente credibili ma generati automaticamente è una svolta per quanto riguarda ciò che chiamiamo dibattito pubblico affidabile”. Ha inoltre aggiunto che questa capacità rende ancora più facile creare confusione, una tattica consolidata nella disinformazione.

Come membri di una società democratica, dobbiamo riconoscere il nostro ruolo nel contrastare la facilità con cui l’IA può essere sfruttata per diffondere disinformazione capace di danneggiare la nostra vita sociale. La responsabilità non spetta solo ai fact-checker o alle autorità ufficiali, ma anche a noi come creatori, curatori e consumatori di contenuti.

Gli LLM presentano due problemi principali:

- Allucinazioni: Gli output generati possono essere privi di base nei dati forniti o significativamente devianti rispetto a informazioni fattuali.

- Qualità dei dati: I modelli sono validi solo quanto i dati su cui sono stati addestrati. Se il dataset di addestramento contiene disinformazione, il modello potrebbe replicarla.

Purtroppo, non esiste una soluzione tecnologica definitiva per verificare l’accuratezza degli output. L’automazione nel fact-checking ha fatto progressi significativi, ma ha ancora limitazioni e non può garantire risultati accurati al 100%.

La vera sfida risiede nel contesto: la complessità e la sensibilità contestuale necessarie per un fact-checking completo sono ancora fuori dalla portata dei sistemi automatizzati. Piccole variazioni nella formulazione di un’affermazione, nella sua tempistica o nel contesto possono renderla più o meno ragionevole. Persino una statistica perfettamente accurata può risultare fuorviante se la correlazione viene confusa con la causalità (ad esempio, il numero di persone annegate in piscina ogni anno può essere correlato al numero di film con Nicholas Cage, ma ovviamente non c’è alcun nesso causale tra le due cose).

Quindi, come possiamo usare le nostre capacità umane di ragionamento e decisione per assicurarci che fatti e numeri siano verificati e utilizzati nel giusto contesto?

Come verificare i fatti e i dati generati dall’IA

- Verifica le fonti: Incrocia i fatti con più fonti affidabili, come giornali autorevoli, database governativi o pubblicazioni accademiche.

- Non fidarti dei link generati dall’IA: Verifica che i link suggeriti siano attivi, che i domini siano affidabili e che le pagine siano rilevanti e accurate. In molti casi, è meglio cercare le fonti autonomamente.

- Usa siti di fact-checking: Strumenti come Full Fact, Snopes o FactCheck.org possono aiutarti a distinguere i fatti dalla finzione.

- Controlla la data: I dati cambiano nel tempo. Assicurati di utilizzare quelli più recenti e pertinenti, considerando che ChatGPT è stato addestrato con un cutoff temporale (ad esempio, settembre 2021).

- Utilizza dati aggiornati: L’accuratezza dei dati è spesso legata al fattore temporale. Ciò che era vero un anno fa potrebbe non esserlo più oggi. Quando utilizzi dati nei tuoi contenuti, verifica sempre la data in cui sono stati pubblicati o raccolti. Cerca di affidarti ai dati più recenti e rilevanti disponibili, e ricorda che il training di ChatGPT si ferma a settembre 2021. Quindi, se chiedi dove vive attualmente la Regina d’Inghilterra, ti risponderà Buckingham Palace (spoiler: non è più così).Anche utilizzando il modello più aggiornato, come ChatGPT 4, non c’è garanzia che i dati siano accurati o aggiornati. Sebbene ChatGPT 4 sia più efficace nel sintetizzare informazioni provenienti da più fonti, OpenAI ammette che il suo tasso di “allucinazione” è simile a quello dei modelli precedenti. In altre parole, è ancora incline a generare contenuti non basati su fatti reali.

Ancora in dubbio? Come gestire informazioni incerte

Quando ti imbatti in informazioni incerte o non verificate, è fondamentale agire con cautela e trasparenza.

Se trovi fatti dubbi o non supportati da prove, valuta l’opzione di escluderli per preservare la credibilità del tuo contenuto. Tuttavia, se l’informazione è cruciale per il tuo argomento ma la sua validità non è chiara, è importante comunicarlo chiaramente al tuo pubblico. Esprimi le incertezze e, se possibile, presenta prospettive alternative disponibili. Per approfondire la questione e magari risolvere l’ambiguità, cerca di consultare esperti della materia nel campo pertinente. (Ricorda anche l’elemento esperienza di E-E-A-T: citare opinioni autorevoli è nel tuo interesse per rafforzare l’autorevolezza del tuo contenuto).

A proposito di opinioni di esperti, assicurati che l’esperto che stai citando sia effettivamente credibile. Pensa come farebbe Google: la persona che stai menzionando è citata su altri siti di qualità? Ha qualifiche rilevanti? È presente in pubblicazioni o riviste accademiche? Ricorda, sei responsabile del fact-checking, anche dello status di chi verifica i fatti.

Come dovremmo usare l’IA, allora?

Finora ti ho spiegato come ridurre i rischi legati all’uso degli strumenti di intelligenza artificiale e come evitare la diffusione di disinformazione. Dopo tutto questo, potresti pensare che strumenti come ChatGPT siano più un problema che una soluzione. Considerando il livello di attenzione richiesto, potresti domandarti se non sia più semplice creare contenuti senza alcun aiuto. E, in parte, c’è un fondo di verità in questo ragionamento.

Tuttavia, come consulente e advisor nel marketing, non considero l’IA come uno strumento per creare materiale grezzo da zero. Piuttosto, la utilizzo per migliorare la mia creatività e ottimizzare la mia efficienza in tre modi specifici. Nota bene: nessuno di questi prevede di chiedere alla tecnologia di inventare qualcosa completamente da sola.

- Accelerazione:

Durante le fasi iniziali del processo creativo, le mie prime idee tendono spesso a mancare di originalità o di quel “guizzo” che le renda interessanti. È una cosa che detesto della scrittura: a volte ci vuole davvero troppo tempo per entrare nel giusto flusso creativo.

Un saggio insegnante di scrittura creativa una volta mi disse che i primi 30 minuti di scrittura servono semplicemente a “tirare fuori le idee pessime dalla testa” per fare spazio a quelle buone. Ed è per questo che può sembrare così doloroso.

Dato che i contenuti generati dall’IA, come quelli di ChatGPT, si basano su materiale preesistente e utilizzano un motore deterministico per restituire il risultato più probabile, lo uso per generare rapidamente queste “cattive” idee. In questo modo, elimino subito i concetti banali o riduttivi. Se ChatGPT riesce a pensarci, probabilmente non è un’idea originale né particolarmente interessante. - Riflessività:

Un altro modo in cui utilizzo l’IA per migliorare la mia creatività è riflettere sul mio stesso lavoro creativo. Ad esempio, dopo aver scritto un articolo o sviluppato un progetto, spesso uso l’IA per riassumere i punti chiave o gli argomenti che ho trattato, in modo da poterli rivedere per verificarne la completezza. Questo mi aiuta a garantire che non abbia dimenticato nulla di importante e che il mio messaggio sia coerente e chiaro.Inoltre, l’IA può aiutarmi a individuare eventuali lacune nei miei argomenti o incoerenze nella mia comunicazione. Questo processo è simile al “rubber-ducking”, ma su scala più ampia: parlare del proprio lavoro con un “ascoltatore” che ti costringe a riflettere su ciò che hai scritto.Detto ciò, continuo a preferire che un editor umano esamini il mio lavoro per una revisione completa, una volta che sono soddisfatto del risultato. - Variazione:

Utilizzo anche l’IA per generare variazioni del mio contenuto originale, permettendomi di esplorare prospettive diverse su come presentare le mie idee. Sperimentando con alternative di fraseggio, strutture di frase o persino l’intera organizzazione dei paragrafi, riesco a individuare modi più coinvolgenti e incisivi per trasmettere il mio messaggio.Di solito non copio e incollo le varianti parola per parola, ma seleziono le parti migliori dagli output generati. A volte si tratta anche solo di una parola che rende il tutto più efficace.

Un processo di convalida è cruciale per ottenere risultati che non sembrino usciti da un generatore automatico senza cervello. Come giustamente sottolinea Aleksandr Tiulkanov, la revisione e il perfezionamento umano sono fondamentali per trasformare gli output dell’IA in risultati che non solo funzionano, ma che sembrano anche il frutto di un essere pensante.

Prendi gli LLM, per esempio. Certo, possono generare metadati o FAQ in quantità industriali, ma senza un tocco umano, rischi di pubblicare contenuti che sembrano scritti da un robot senza personalità (spoiler: lo sono). Mi piace immaginare gli LLM come i miei stagisti virtuali: loro fanno il lavoro pesante, ma io decido cosa finisce sul tavolo.

Come trovare il giusto equilibrio tra automazione e cervello umano

1. Rivedi gli output per l’allineamento al brand

Gli LLM possono sfornare contenuti a velocità stratosferiche, ma non hanno la minima idea di cosa significhi “voce del tuo brand”. Immagina di vendere un prodotto di lusso e l’IA ti scrive qualcosa che suona come un volantino di un discount. Il risultato? Cringe garantito. Assicurati sempre che gli output riflettano il tono, il messaggio e i valori del tuo brand.

2. Monitora pregiudizi ed errori etici

Ah, la neutralità dell’IA. Spoiler: non esiste. Gli LLM non hanno contesto né sensibilità culturale, il che significa che potrebbero generare contenuti inappropriati o culturalmente insensibili. Serve l’occhio umano per garantire inclusività e rispettare gli standard etici. Altrimenti rischi di finire nel prossimo articolo su “gli epic fail del marketing”.

3. Affina per qualità e specificità

Gli output degli LLM tendono a essere generici come un bigliettino di auguri prestampato. Vogliono piacere a tutti, ma finiscono per non convincere nessuno. Affina e personalizza i contenuti per soddisfare le aspettative degli utenti e le esigenze di qualità del tuo progetto. Insomma, aggiungi quel tocco che fa la differenza tra “meh” e “wow”.

4. Fai fact-checking

L’IA può generare testi con l’apparenza della competenza, ma ciò non significa che siano corretti. Magari ti tira fuori informazioni vecchie di anni o semplicemente sbagliate. Verifica sempre i fatti e assicurati che ciò che pubblichi non faccia ridere gli esperti del settore (o piangere i tuoi clienti).

5. Evita il plagio

Gli LLM si basano su modelli addestrati con dati preesistenti, il che significa che possono facilmente rigurgitare contenuti simili a quelli di altre fonti. Non vuoi che il tuo contenuto sembri copiato, vero? Usa strumenti per controllare l’originalità e, se necessario, riscrivi per evitare accuse di plagio.

Conclusione (senza troppa fuffa)

Ecco il punto: ChatGPT e altri strumenti di IA possono davvero trasformare il tuo flusso di lavoro SEO, ma solo se accoppiati con cervello umano e un processo di convalida che eviti figuracce. Sperimenta, gioca con librerie di prompt, esplora nuovi strumenti, ma ricordati: senza il tuo tocco finale, il risultato potrebbe sembrare più “robotico” che efficace.

E no, i clienti non pagano per contenuti che sembrano usciti da una fabbrica di frasi fatte.

Share this article

Ultimi articoli

Aprile 30, 2026

Aprile 30, 2026

Aprile 30, 2026